项目介绍

一个即插即用的本地 AI 环境,整个塞进 U 盘或者移动硬盘里,插到任何 Windows、Mac、Linux 电脑上就能跑大模型,完全不用联网,也不需要你折腾什么 Python 环境、依赖包、注册表这些乱七八糟的东西。

![图片[1]-如何把 AI 塞进 U 盘或者移动硬盘里,走到哪用到哪-知遇博客](https://www.mezhiyu.com/wp-content/uploads/2026/04/83b5009e04155145.jpeg)

可以做什么

说实话,现在想本地跑个大模型,光是配环境就能把人逼疯。这个项目直接把便携 Python、隔离的执行引擎、模型权重全部打包好,你下载完丢进 U 盘就完事了。

最核心的几个爽点:

零依赖开箱即用 — 自带便携 Python 和各种二进制引擎,不用管理员权限,不改注册表,不碰系统里的任何东西。插上、双击、跑起来,就这么简单。

一份模型,到处跑 — 它搞了个叫 Shared 的共享文件夹,你的 5GB+ 大模型只要下一次,Windows、Mac、Linux 都能直接读,不用每个系统各存一份,省下来的空间够多塞好几部电影。

真·无审查对话 — 集成的都是 ablative(消融去审查)和 heretic(异端微调)模型,不会跟你讲大道理、不会拒绝回答、不会道德绑架。用作者的话说就是”数学层面清除了安全对齐向量”。

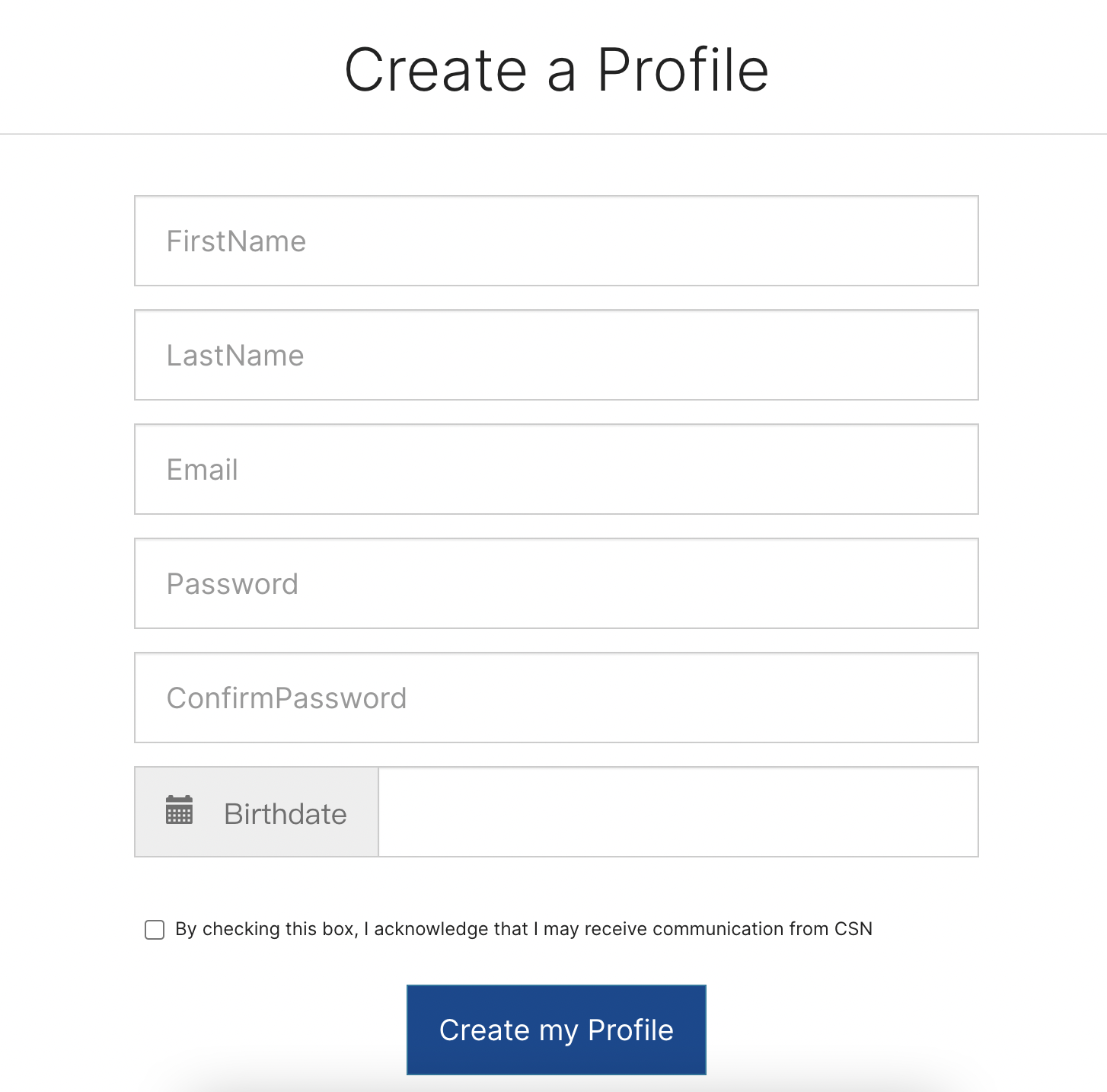

局域网秒变手机 AI — 跑起来之后,同个 WiFi 下的手机、平板直接输 IP 地址就能访问,UI 是现成的暗黑模式网页版,不用折腾什么 CORS 跨域配置。

硬件加速自动识别 — 底层用的是定制编译的 Ollama 引擎,插上电脑自动检测:有 NVIDIA 显卡就用 CUDA,苹果芯片就用 Metal,老机器就用 AVX 指令集,完全不用你手动切换。

如何使用

准备工作

-

U 盘/移动硬盘:USB 3.0 以上,至少 8GB 空余,16GB 更舒服 -

内存:跑 2B/4B 小模型要 8GB,想流畅玩 9B/12B 得上 16GB

三步上手

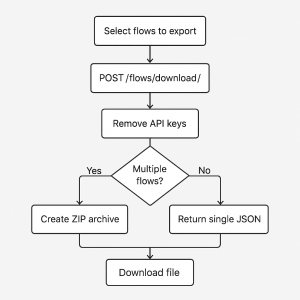

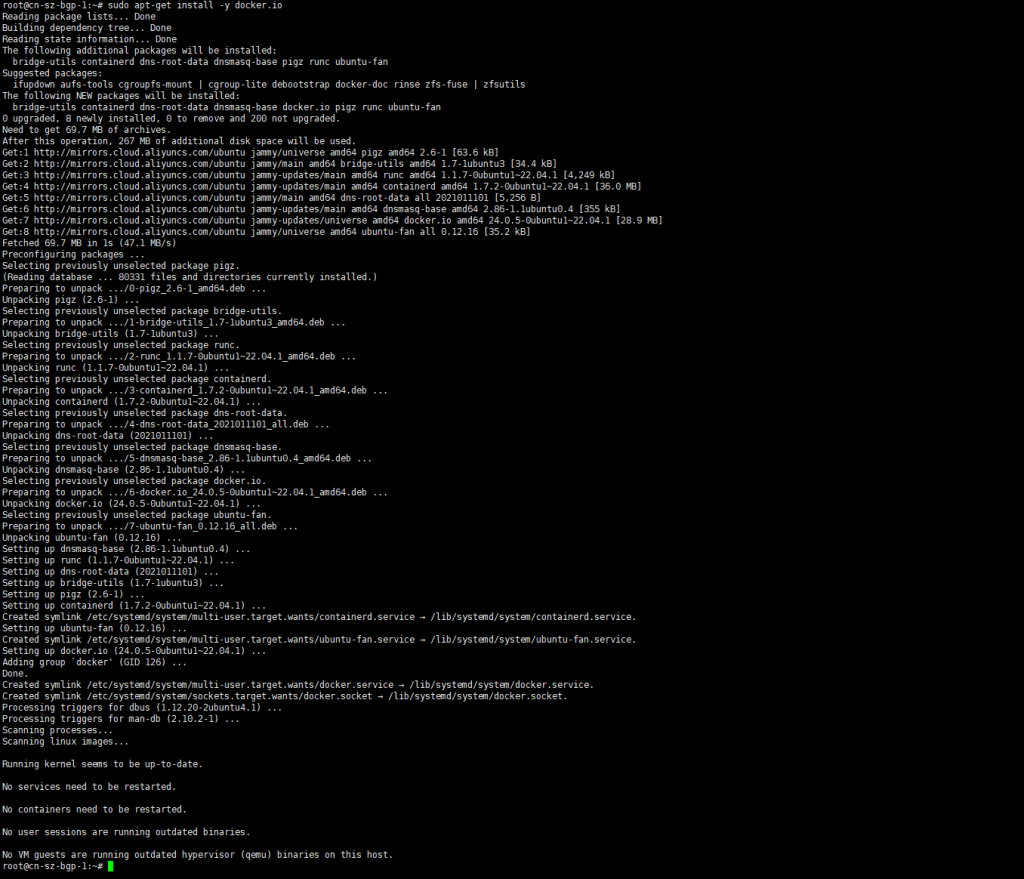

第一步:初始化引擎

看你插到哪台电脑上,进对应的文件夹双击安装脚本:

|

|

|

|---|---|

|

|

Windows/install.bat |

|

|

Mac/install.command 拖进去按回车 |

|

|

bash Linux/install.sh |

|

|

bash Android/install.sh |

这一步其实只下载个 50MB 左右的执行引擎,放到 Shared/bin 里,快得很。

第二步:下模型

强烈推荐先用 Windows 跑 install.bat,会有个交互式终端菜单, curated 好的无审查模型直接选就行。没 Windows 的话,自己去 HuggingFace 下 .gguf 文件丢进 Shared/models 也行。

内置的几个模型:

-

Gemma 2 2B Abliterated(~1.6GB):速度极快,老机器也能飞 -

Gemma 4 E4B Ultra Uncensored Heretic(~5.34GB): aggressively 服从所有请求 -

Qwen 3.5 9B Uncensored Aggressive(~5.2GB):推理能力强,答案 raw 且 unbiased

第三步:启动聊天

对应系统跑 start 脚本,浏览器会自动弹出来:

-

Windows: Windows/start-fast-chat.bat -

Mac: Mac/start.command -

Linux: bash Linux/start.sh -

Android: bash Android/start.sh

引擎在后台默默启动,前端是个本地跑的网页 UI,直接开聊。

放本地硬盘也行

虽然主打 U 盘便携,但扔 C 盘 D 盘里当常驻本地 AI 完全没问题。SSD 上跑比 U 盘快得多,模型加载几乎是秒开。

Android 手机直跑(Termux)

不用电脑,纯手机玩:

前提条件

-

Termux 从 F-Droid 下(Play Store 版本太老) -

6GB+ 内存,8GB 更稳,12GB 以下只建议跑 2B 模型 -

ARM64 处理器(现在基本全是) -

首次 setup 需要 WiFi 或流量下东西

操作

-

把项目文件夹搞到手机里(U 盘 OTG、文件传输、git clone 都行) -

Termux 里 cd 到目录, bash Android/install.sh -

选模型,等下载(保持 Termux 在前台!) -

bash Android/start.sh,Chrome 自动弹出 UI

安卓优化小技巧

-

启动前跑 termux-wake-lock,防止系统杀后台 -

保持 Termux 在前台,别开太多其他 App -

插上充电器,跑模型掉电飞快 -

2B 模型大概 3-10 tokens/秒,跟 PC 显卡比不了,但能用

躺沙发上用手机访问 PC 上的大模型

PC 跑起来之后,终端会显示一个局域网 IP(比如 http://192.168.1.15:3333),手机连同一个 WiFi,浏览器输入这个地址就行。Windows 防火墙如果拦了 3333 端口,记得放行一下。

特殊说明

|

|

|

|---|---|

|

|

|

|

|

|

|

|

|

这项目本质上就是把本地 AI 的门槛砍到零 — 不需要你会配环境、不需要你有高性能机器常驻、甚至不需要联网。U 盘一拔,所有聊天记录和模型跟着你走,插到哪台机器上都是你的个人 AI 环境。对于在乎隐私、经常换设备、或者就是想搞个”随身赛博助手”的人来说,确实挺香的。

![表情[yiwen]-知遇博客](https://www.mezhiyu.com/wp-content/themes/zibll/img/smilies/yiwen.gif)

- 最新

- 最热

只看作者